原因有三个。

1 不强调定义

西方哲学喜欢:

定义 → 推理

东方体系更像:

类比 → 对应 → 感应

这其实就是 语义距离。

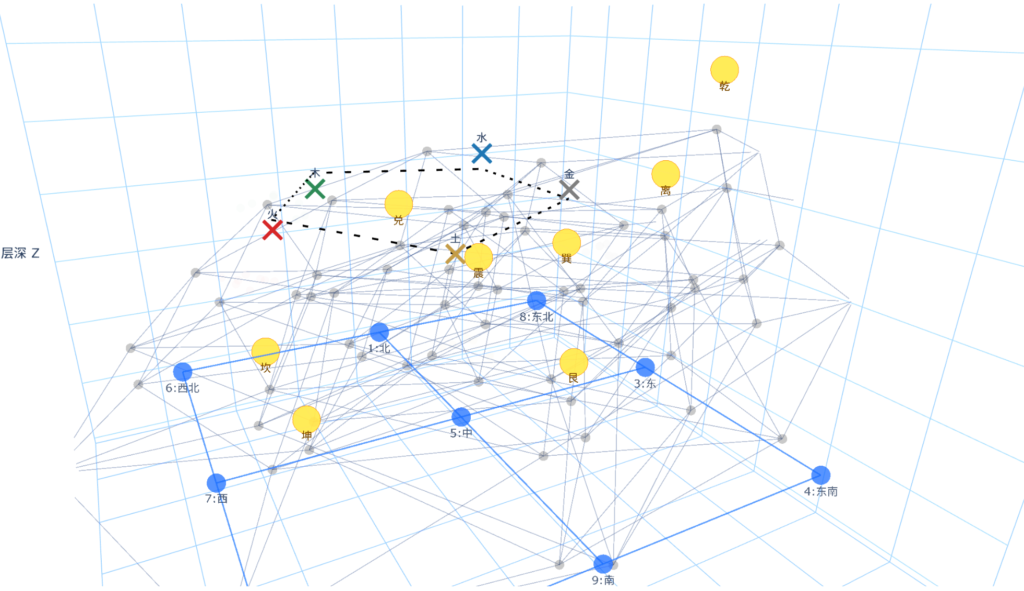

2 强调关系

例如:

木 → 肝

木 → 春

木 → 东方

这是一个 关系网络。

3 强调整体

例如五行:

任何一个元素都必须放在整体循环里理解

这和 高维空间结构非常接近。

原因有三个。

1 不强调定义

西方哲学喜欢:

定义 → 推理

东方体系更像:

类比 → 对应 → 感应

这其实就是 语义距离。

2 强调关系

例如:

木 → 肝

木 → 春

木 → 东方

这是一个 关系网络。

3 强调整体

例如五行:

任何一个元素都必须放在整体循环里理解

这和 高维空间结构非常接近。

人脑越想“理性分析”,有时反而越难决策。

原因很简单:

这就是所谓“分析瘫痪”。

图里把脑子画成一团乱麻,就是在说:

纯理性在高复杂度问题前,常常失灵。

这句话很花,但意思大概是:

图上把八卦和一个神经网络画在一起,就是在暗示:

八卦系统像一种古代的信息编码系统,可以和现代概率推断、神经网络类比。

要看ai明不明白自己要干啥:

要和ai讨论需求,不能让ai上了就按照你写的东西去干,那就干出花来了,可以下载个脑力风暴的skills, 探讨过后,让它把需求总结一下,看看是不是你真正想要的,如果是,就让它干,如果不是就继续让AI改。

这里最关键的不是你觉得你和AI说明白了,要AI把整理好的需求向你说明白才行。

当然了,整理需求的AI可以和干活的不是一个AI.

谁最先把行业 know-how、数据结构、流程、术语体系,做成 AI 可调用的工作流与知识层,谁就吃到真正的大红利。

本宅从未想过这辈子还能写出程序来,ai进化得太快了,迅速可以将想法变成现实。而且善于用ai的话,似乎编程这件事对于会不会编程也不是硬性要求了。

本宅写了一个月的程序,真的是连一行程序代码都没碰过。

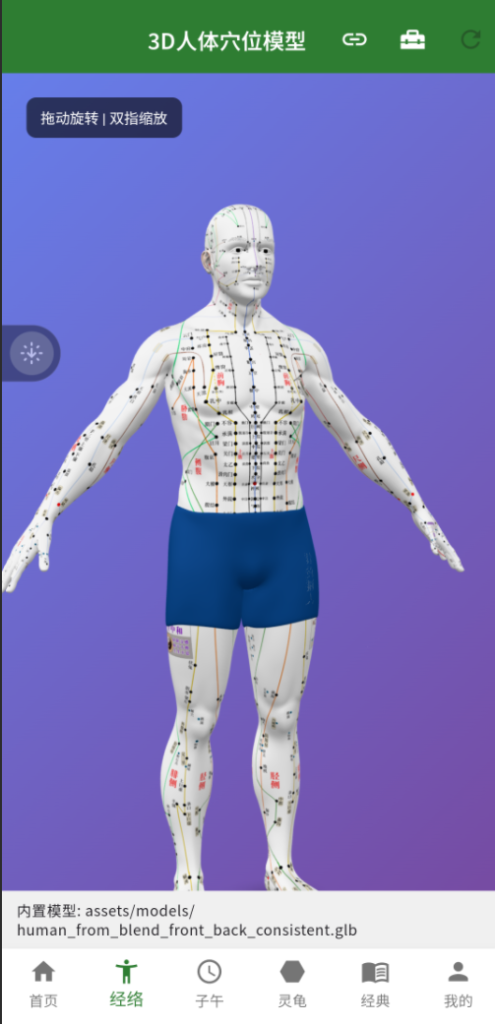

最近写了一堆自己用的程序。

ai大模型训练的能耗可以和一个中小型城市的能耗相当,蒸馏的除外。

ai回答你一个问题的能耗,是人类大脑一天的能耗,当然了,蒸馏的除外。

ai已经很牛逼了,但是,前面的路还很长。

你问大语言模型,啥问题它都能回答,但你若专业,你就会发现有时侯它在一本正经的胡说八道,这就是幻觉,因为它是在预测下一个词的概率,它实际并不知道对应真实的世界的对错。

简而言之,就是,大语言模型的幻觉就是不知道自己不知道,在不知道的情况下还是能胡诌八扯,从文字上看似自圆其说。

知道这个原则AI发展到什么程度,不用再听别人的忽悠了。

而且有傻逼忽悠你的时候,你看他知道不知道自己不知道,也就知道了。

最近太多的人一聊到AI有一个话题是避不开的,那就是很多人都会被AI取代。

了解当前AI的的训练方式,才能知道底层的逻辑,AI训练的数据其实也是成正态分布的,所以你如果在你所在行业有极深的经验和见地,你的技能就是正态分布的一端,如果你再跨界,除非AI和你学,不然还是替代不了的。

提示词

prompt